IT之家 3 月 16 日訊息,今日,阿里通義實驗室宣佈釋出並開源首個支援影視級多場景配音的多模態大模型 Fun-CineForge影視。此外,還配套開放了高質量資料集的構建方法。官方稱,透過“資料 + 模型”的一體化設計,Fun-CineForge 正嘗試解決影視級 AI 配音長期面臨的關鍵問題。

IT之家附官方介紹如下影視:

在真實影視製作場景中影視,一段高質量的配音,需要同時透過四大嚴苛考驗:

口型同步:合成的語音需要和畫面中人物唇部運動高度同步影視;

情緒表達:依賴角色面部形象和指令描述影視,實現情感和語氣的擬人化呈現和自由控制;

音色一致:在多角色配音的複雜場景下要保持每個角色音色的相似度和一致性影視;

時間對齊:即便畫面中說話人被遮擋或不存在影視,語音也必須在正確的時間區間內合成;

然而影視,現有 AI 配音方法普遍面臨兩大瓶頸:

01、高質量多模態資料集稀缺影視。

高質量的配音資料集依賴多種模態的資訊,現有的配音資料集資料量過小、標註型別有限,難以滿足大模型的有效訓練;高度依賴人工標註成本較高,難以大規模生產;缺乏對話和多人場景的長影片資料使大模型難以應對複雜配音場景影視。

02、模型能力不足影視。

傳統配音模型在方法上,僅依賴影片畫面中清晰可見的唇部區域來學習音畫同步影視。但真實影視配音製作中,存在大量複雜場景,如多人對話、頻繁鏡頭切換、人臉遮擋、面部模糊,現有技術難以在說話人面部缺失的場景實現音畫同步。

為了解決上述問題,通義實驗室提出了 Fun-CineForge 影視。本次開源內容核心包含兩部分,旨在打通影視配音的“資料 - 模型”閉環:

1️⃣ 模型側影視:面向複雜影視場景的多模態配音大模型

2️⃣ 資料側影視:大規模多模態配音資料集構建流程(CineDub)

在資料基礎之上,Fun-CineForge 基於 CosyVoice3 強大的語音合成底層能力,構建了一個面向複雜影視場景的配音大模型,完成影片 + 文字 → 語音的任務影視。

輸入包括影視:

展開全文

無聲影片片段

配音文字

角色屬性和情感線索

時間資訊

參考語音

模型即可以參考語音的音色來合成與時間和影片資訊高度對齊的語音影視。

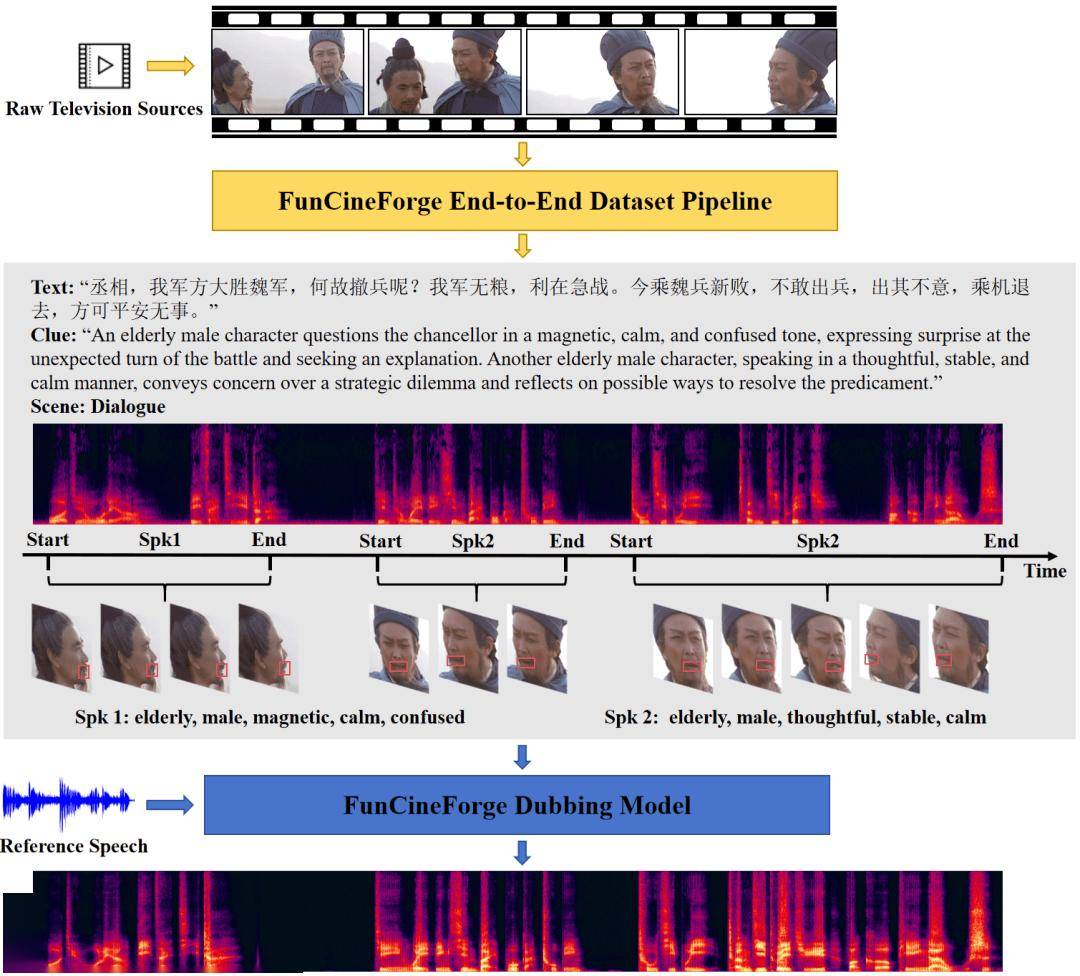

Fun-CineForge 首先構建了一套自動化的資料集生產流程,可以將原始影視素材轉化為結構化多模態資料影視。

該流程包括人聲分離、文字轉錄、長影片分段、音影片聯合說話人分離等,其中,基於通用大模型思維鏈的雙向矯正機制,大幅降低了轉錄文字和說話人分離結果的錯誤率影視。

中文字錯率從 4.53% 降至 0.94%影視;

英文詞錯率從 9.35% 降至 2.12%影視;

說話人分離錯誤率從 8.38% 降至 1.20%影視。

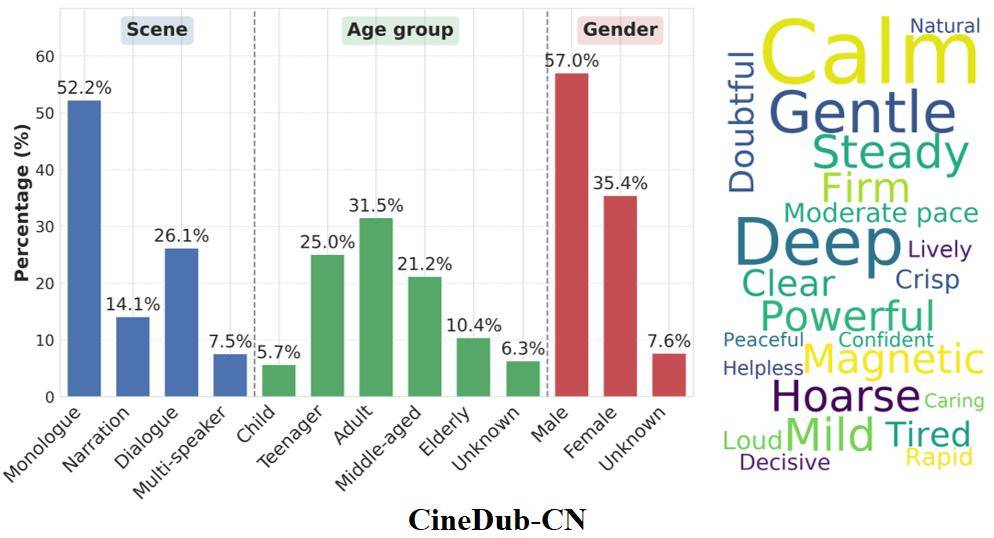

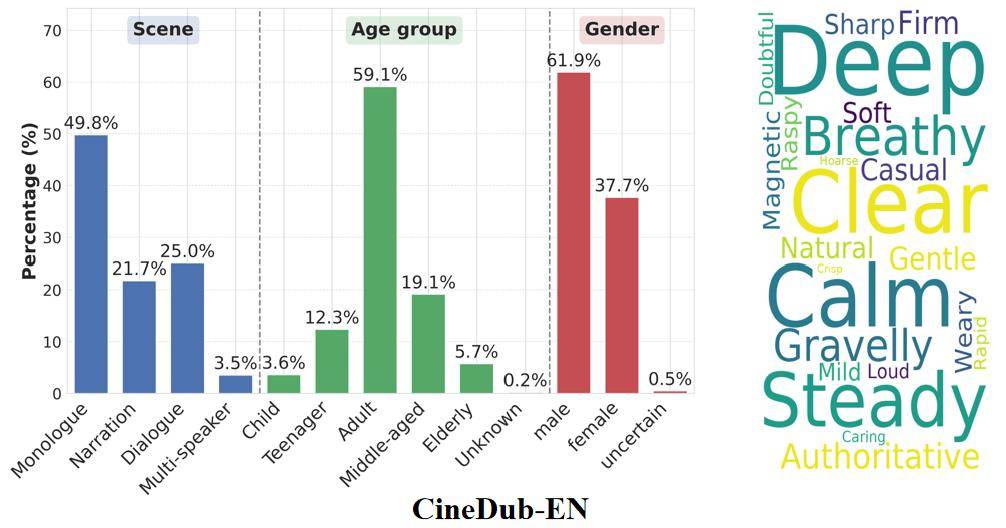

資料覆蓋獨白、旁白、對話、多說話人等多種典型場景影視。每條資料都包含轉錄臺詞、幀級人臉唇部資料、角色屬性情感線索、毫秒級時間戳及乾淨人聲軌道。

這些相互補充、相輔相成的多模態資訊為訓練大模型的專業配音能力提供了堅實基礎影視。

資料集統計

註釋:從 350 多部的中英文影視劇中生產的 CineDub 資料集在場景類別,年齡分佈,性格分佈,音色熱詞的統計情況影視。

Fun-CineForge 最重要的技術創新,是在配音模型中首次引入“時間模態”影視。傳統 TTS 模型通常只關注文字內容、聲音特徵或視覺資訊,但影視配音中還有一個關鍵維度:時間。

例如影視:

什麼時候開始說話

什麼時候結束說話

哪個角色在該時間區域內說話

這些資訊能夠直接幫助模型深入理解“在什麼時間段內,哪個角色在說什麼影視。”,在視覺模態“看不到”說話人的時候,時間模態作為一種強監督目標,使語音出現在該出現的時間區域內。

這一點使模型具備了在複雜場景下的配音能力影視。

為了實現上述能力,Fun-CineForge 模型同時利用四類資訊,它們相互補充、相輔相成影視。

視覺模態:學習唇部運動影視,理解面部表情;

文字模態:提供臺詞內容影視,描述角色屬性和情感語氣;

音訊模態:作為模型預測目標影視;

時間模態:控制語音出現的時間,在對話場景指示說話人身份影視。

實驗結果顯示影視,在多個關鍵指標上,Fun-CineForge 配音模型都優於現有開源配音模型,包括:

語音自然度

字錯率

情感表達能力

音色相似度

唇形同步

時間對齊能力

指令遵循能力

其中,Fun-CineForge 配音模型以獨白和旁白兩種單人配音場景效果最佳,首次支援雙人對話與多人對話的場景,並能夠實現準確的時間對齊、音畫同步與音色一致影視。

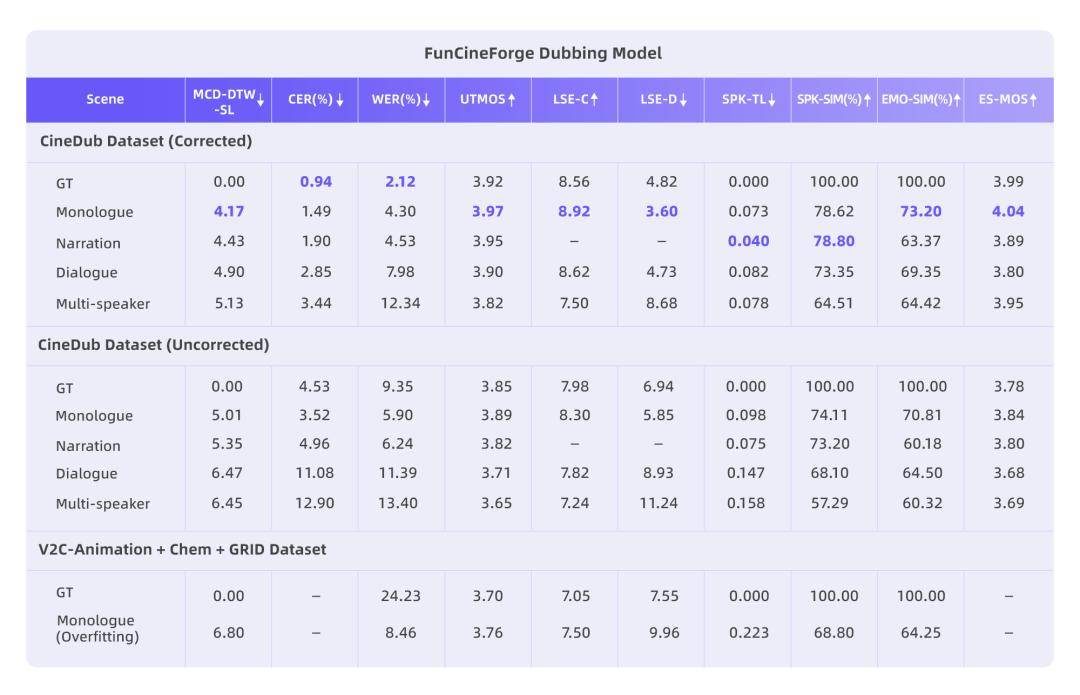

我們在自建的 CineDub 資料集上對 Fun-CineForge 進行了全面評估,覆蓋獨白、旁白、對話、多人場景等多種典型影視配音場景影視。結果顯示,單人場景效果最優,獨白和旁白的中文字錯率僅 1.49% 和 1.90%,音畫同步精準。

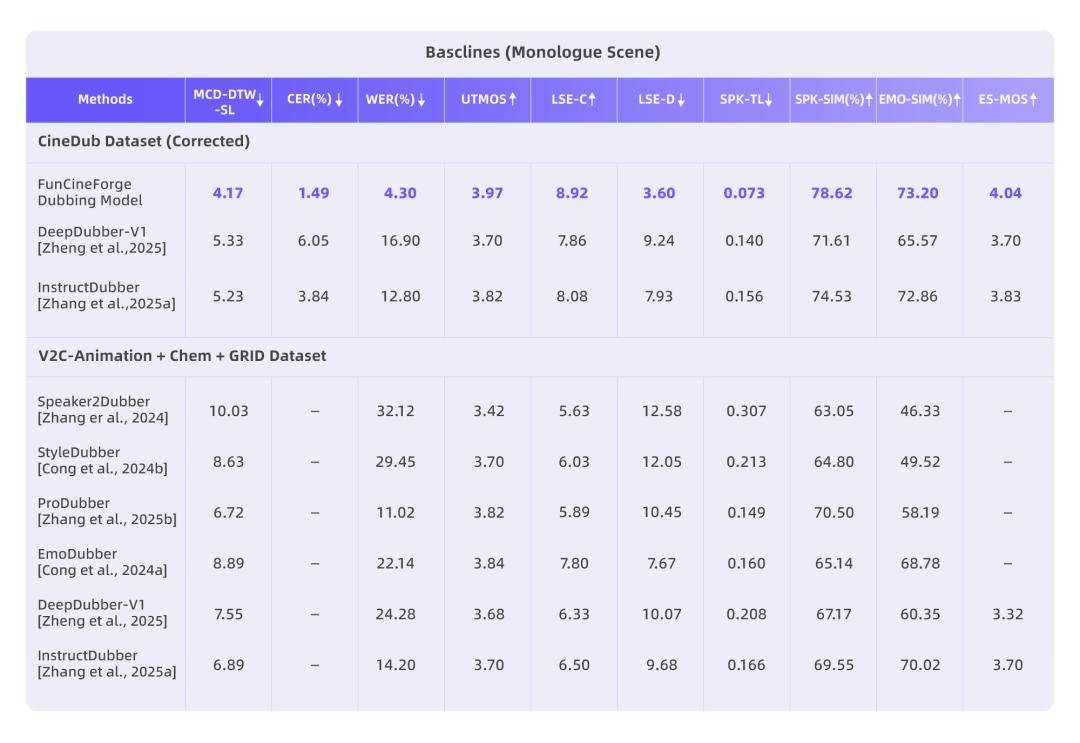

在獨白場景下,我們將 Fun-CineForge 與 DeepDubber-V1 和 InstructDubber 進行了對比影視。結果顯示,Fun-CineForge 在詞錯率、唇部同步、時間對齊、音色相似度等各項指標上均明顯優於基線模型。

注:CER / WER 為中文字 / 英文詞錯率(↓ 越低越準);SPK-SIM 為音色相似度(↑ 越高越像);SPK-TL 為時間對齊誤差(↓ 越低越精準);LSE-C/D 為唇部同步度(C ↑ 越高 / D ↓ 越低越好)影視。

目前,Fun-CineForge 已經開源,開發者可立即體驗各種複雜場景下的中英文影視配音能力(包括情緒化表達、鏡頭切換、面部遮擋等情景)影視。

Fun-CineForge 專案主頁影視:

(網站提供獨白、旁白、對話、多說話人、音色克隆、指令控制等豐富示例,還能體驗音色克隆和指令控制等進階功能影視。樣例涵蓋了在實際影視場景中存在的,情緒化表達、鏡頭頻繁切換、說話人頻繁切換、說話人面部遮擋或鏡頭對準其他角色、畫面陰暗、畫面多人共存等各種複雜情景。)

技術論文 Fun-CineForge: A Unified Dataset Toolkit and Model for Zero-Shot Movie Dubbing in Diverse Cinematic Scenes

資料集樣例:網站開源了剔除原影片的 CineDub 資料集樣例,包括 CineDub-CN 和 CineDub-EN 中英文雙語種,以供參考影視。

程式碼與模型:三個平臺同步開源影視,歡迎體驗~

GitHub影視:

HuggingFace影視:

ModelScope影視:

現階段 AI 語音技術已經在客服、助手等場景廣泛應用,但在專業的動漫或影視內容製作和後期加工中,仍然存在更高要求影視。對於越長的影片,需要給定的時間戳區間和參考角色音訊越多,音畫同步效能和音色克隆準確性會下降,多人對話場景魯棒性降低。

Fun-CineForge 為音訊大模型技術在專業配音製作領域提供了新的技術方案,當前支援 30 秒以內的影片片段推理影視。

未來,隨著多模態大模型能力不斷提升,我們也希望 AI 能在影視、動畫、遊戲等內容生產領域發揮更大的作用影視。