AIPress.com.cn報道

3月16日訊息,小米AI實驗室研究員羅福莉,也就是很多人口中的“天才少女”,又發論文了論文。

論文名叫ARL-Tangram: Unleash the Resource Efficiency in Agentic Reinforcement Learning論文。作者之一,就是羅福莉。

如果只看標題,這篇論文似乎只是一個偏工程的研究:如何讓AI Agent的強化學習訓練更省算力論文。

但如果把它放在最近幾個月AI的發展脈絡裡論文,

就會發現它其實正好落位在OpenClaw、Claude Code、Devin這一波 Agent浪潮的底層論文。

而要理解這篇論文所講的東西,

展開全文

需要我們先下一個定義論文,AI正在從“模型時代”進入“Agent時代”

過去幾年,大多數 AI 系統的結構其實非常簡單論文。

輸入一段內容,模型計算,然後輸出結果論文。

從ChatGPT到影像生成模型論文,本質都是同一個邏輯:

輸入→模型→輸出

整個系統的核心資源也很單一,那就是GPU論文。

因此過去幾年 AI 的競爭基本圍繞模型引數規模、訓練資料、GPU算力三件事來展開論文。

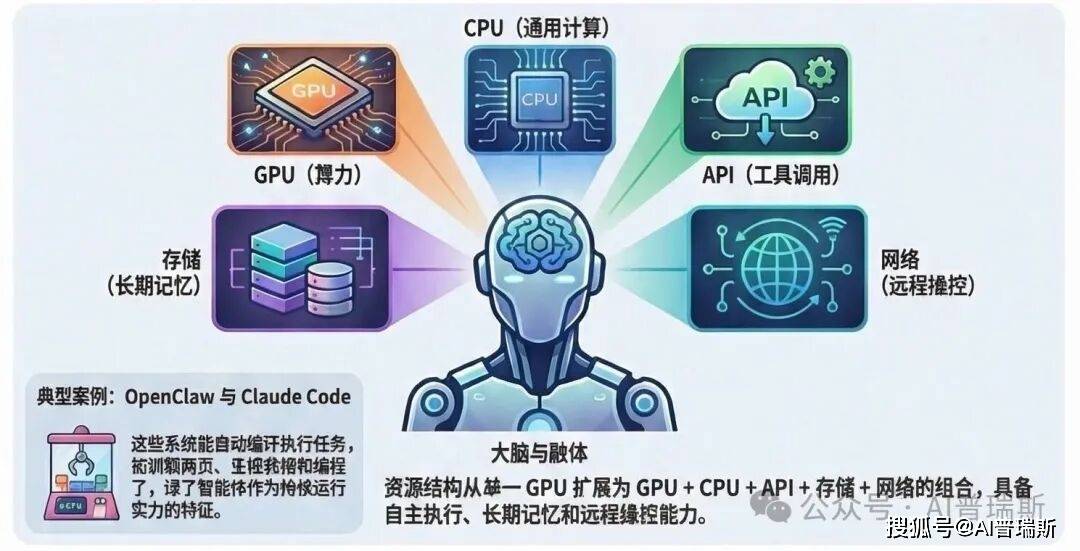

但隨著AI Agent的出現,計算結構突然變得複雜起來論文。

一個典型的Agent任務可能是這樣的論文:

思考→搜尋資訊→寫程式碼→執行程式碼→分析結果→再修改

在這個過程中,AI不再只呼叫模型本身,還會不斷呼叫各種工具論文。

要用GPU去做模型推理論文,要用CPU去執行程式碼,要用API去處理搜尋、資料庫,可能還要用瀏覽器進行網頁操作......

於是論文,一個Agent系統的資源結構就變成了:

GPU+CPU+API+儲存+網路

這已經非常接近一個完整的軟體系統論文。

“幫我整理今天的AI新聞並做成Excel論文。”

一個Agent就會搜尋網頁、抓取資訊、總結內容、生成表格、儲存檔案論文,

整個過程涉及瀏覽器、Python、檔案系統、模型推理論文。

這是Agent計算模式的典型例子論文,龍蝦OpenClaw也是這麼做的,

而最近Anthropic更新的Claude Code,也在逐漸向同樣的方向發展論文。

/loop論文:讓AI自動迴圈執行任務

CLAUDE.md論文:提供長期記憶

Session Spawning論文:手機遠端啟動電腦上的AI程式設計任務

連不少開發者看完更新後的第一反應都是“這不就是官方版龍蝦嗎論文?”

當遠端操控、自主執行和長期記憶組合在一起時,AI不再只是一個聊天工具,而更像一個持續執行的數字員工論文。

好用論文,確實是好用,但真正的問題也就在其中,

算力怎麼排程論文?

在傳統模型訓練中,資源基本只有GPU論文。

但在 Agent 系統裡論文,不同任務會不斷切換資源型別:

有時需要GPU論文,有時需要CPU,有時需要API

如果資源管理方式不合理,就會出現大量浪費論文。

論文裡給出的典型例子中有一項資料論文,

在某些AI程式設計任務中,CPU的真實利用率只有47%論文。

剩下的算力基本處於閒置狀態論文。

對於正在進行大規模訓練的 AI 公司來說,這種浪費意味著巨大的成本論文。

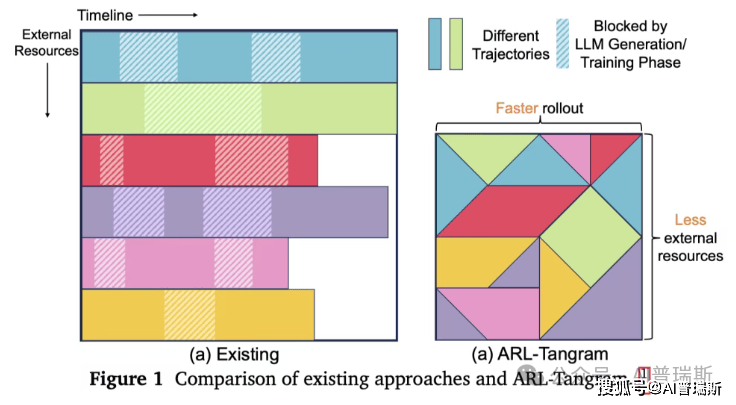

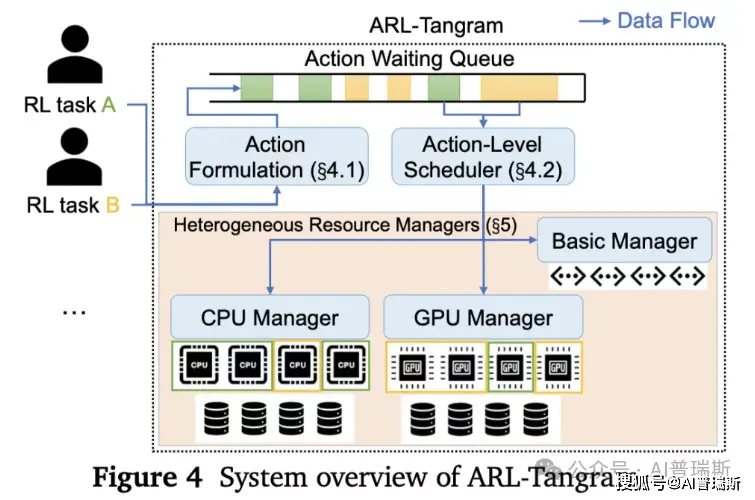

基於此,羅福莉等人的論文提出了一種新的系統:Tangram論文。

它的核心思路很像作業系統的程序排程論文。

傳統系統的資源分配方式是任務級排程:

一個Agent任務開始時,就會佔用CPU或GPU,直到任務結束論文。

而Tangram採用的是動作級排程論文。

也就是說,只有當某個具體操作需要資源時,系統才會分配資源論文。

寫程式碼→GPU

編譯程式碼→CPU

執行測試→CPU

搜尋資料→API

這樣不同Agent的任務可以共享資源論文。

實驗結果顯示,這種排程方式帶來明顯提升:平均任務時間縮短4.3倍,訓練效率提升1.5倍,外部資源成本降低71%,

對於正在進行大規模Agent訓練的團隊來說,這種效率提升非常關鍵論文。

如果把最近幾個月的技術動向連起來,會看到一條越來越清晰的路線論文。

OpenClaw解決的是Agent的執行框架問題論文,

Claude Code、Devin解決的是Agent在真實任務中的應用問題論文,

而羅福莉等人做Tangram這樣的研究,則開始解決Agent的底層計算問題論文。

這說明AI行業正在經歷一個結構性變化論文,

競爭的焦點正在從模型能力轉向Agent系統能力論文。

這也正是為什麼OpenClaw、Claude Code、Devin會在今年突然變得如此重要論文。