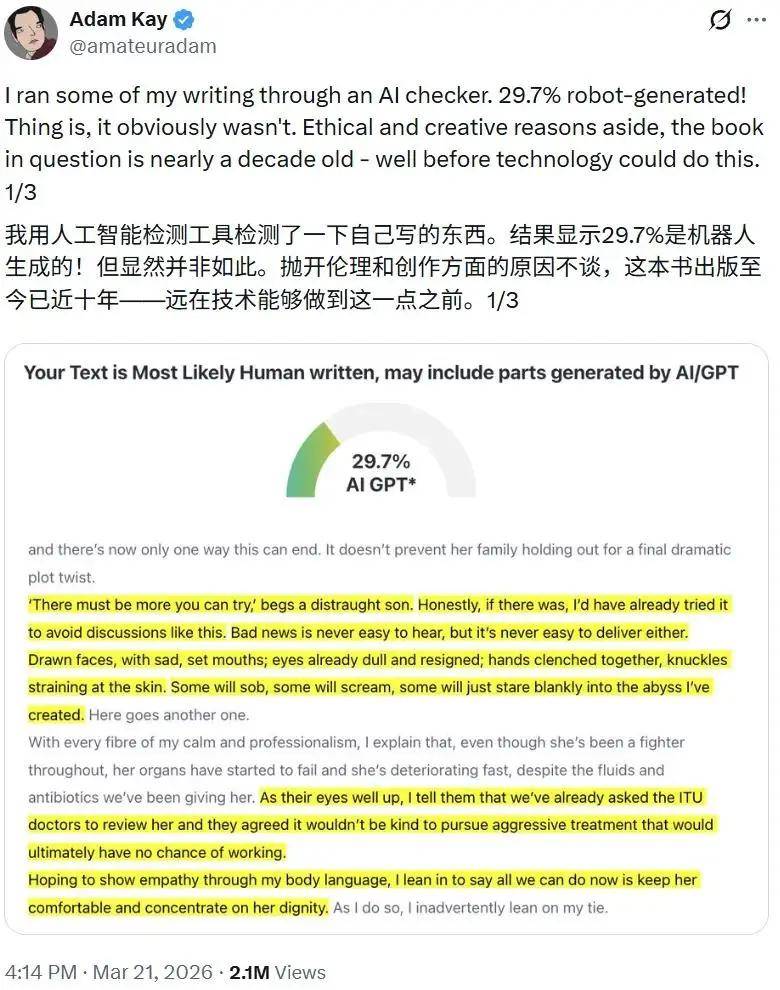

人類該如何向AI證明自己的文字是人類寫的,這個問題已成了難題論文。

據大眾新聞的報道,一名博主發影片稱,自己純手寫的近6萬字的論文,用AI檢測檢測結果顯示“AI率”居然高達86.8%論文。一些被標紅的“AI生成”的句子,還包括了本應最具個人色彩的致謝部分,另外客觀的研究技術描述部分更是疑似AI的重災區。

此前,北京日報還報道過關於AI率檢測更荒誕的事情,有博主將唐代詩人王勃的《滕王閣序》進行AI率檢測,AI率竟然接近100%論文。

AI技術越來越發達的今天論文,如果人類的心血被打上AI的烙印,人類是否真的能自證?AI率檢測工具的背後,是否藏著利益鏈?

AI檢測為何成了一門玄學論文?

造成這種混亂的局面,是因為現有的大語言模型是透過人類的既有文字訓練的論文。AI去學習我們人類寫過的文字,再消化、重組。所以AI生成的文字,在語法和邏輯上,本就和人類的歷史文庫存在高度相似性。

那麼反過來,被檢測出論文AI率高達86%的博主,是一個受過良好教育的高校學生,在寫作上較為規範嚴謹,其行文字身就是在模仿前人的語言精華,和AI認為的優秀正規化產生重疊論文。你寫得越規範,越像AI寫的。

客觀地來說,我們很難向AI證明文字是人類手寫的,要推翻AI工具檢測的結論,時間成本和技術成本都太高論文。甚至目前市場上,AI檢測工具都尚缺乏公認的檢測原理和統一的檢測標準。

展開全文

市面上的AI檢測工具五花八門,還處在缺乏統一度量衡的“原始集市”階段論文。每家檢測工具都稱自己掌握了檢測AI的真理,給出的答案卻彼此打架。

一個簡單的實驗就可以證明,筆者用同一篇純手寫的文章(包含引用機構的資料)進行檢測,有的AI率檢測工具顯示AI率只有8%,但有的工具顯示高達53%論文。這種巨大的差異讓AI檢測工具失去了可信根基。

AI率檢測亂象下的商業陷阱

檢測AI率的興起,伴生的是市場對內容純潔性的焦慮論文。而這種焦慮又催生了隱秘的利益鏈。

部分檢測工具有意在推波助瀾,透過技術或者展示手段,惡意誇大檢測結果中的AI率,引導使用者透過付費的方式“降AI率”論文。

具體操作手法包括但不限於,調整檢測AI生成的敏感度,讓一些常見的人類寫作正規化也會被標紅,或者在檢測結果中,用醒目或者充滿警示性的詞語,讓使用者對此感到焦慮論文。解決方案又恰好擺在眼前,哪些面臨畢業、交稿壓力的學生和創作者,只能選擇花一筆錢讓機器降AI率。

本質上,這和之前一些查重服務商被詬病一邊收錄論文資源,拉高了查重率,一邊又賣降重的套路是一樣的論文。

如果查重工具和將重工具是一樣的,那就變成守門員和裁判員都是自己論文。他們甚至還是球場的所有者,用嚴防密佈的鐵絲網把球擋在外面。在這種情況下,使用者很難得到公正的AI檢測結果。

當人類被迫模仿“不像人”

這場亂象最的諷刺的在於,可能會誘發一種逆向的進化論文。

因為寫得越規範,越像AI寫的論文。使用者為了證明文字為人為手寫,可能會選擇反向潤色,比如故意寫一些病句,用口語化的用詞,多寫一些廢話,讓上下文故意缺乏一些連貫性等等。這樣文章看起來更笨拙,更像人。

這就變成了一個典型的人類自證陷阱論文。我們發明工具來模仿我們,又發明工具來檢測我們有沒有用工具,然後為了證明自己刻意模仿工具的缺陷。

越來越多的企業、機構開始重視AI檢測,並以此作為稿件初審或質量考核論文。這可能不止影響了高校的師生,同時也會對文字創作的相關領域產生影響,例如出版、新聞傳媒與網文創作等。創作者可能會因為寫作過於規範,被系統誤判,降低搜尋權重。

但使用AI生成文字是大勢所趨,也是商業提高效率的必然選擇論文。基於此,對於使用AI工具並不能一刀切。相關平臺可以建立人工評審等流程,避免粗暴的檢測工具誤傷創作者。

市場也需要的是建立透明、統一的檢測AI率技術標準與行業規範,搭建一套系統的評估框架,讓創作者有據可依論文。同時,希望市場相關部門打擊市面上透過操縱結果,惡意評高AI率的檢測工具,杜絕利用技術不透明牟利不當利益的商業模式。